深度丨为什么变革性人工智能很难实现,从技术、社会和经济三方面综合探讨

撰文:《经济学人》记者 Arjun Ramani;谷歌 DeepMind 研究工程师 Zhengdong Wang

来源:The Gradient

人类在创新方面有着不错的成绩。农业机械化、蒸汽机、电力、现代医学、计算机和互联网,这些技术从根本上改变了世界。尽管如此,世界前沿经济体人均 GDP 的趋势增长率从未超过每年百分之三。

当然,增长加速是可能的。[1] 在增长开始之前会有那么一段时间,或者至少是在增长远接近于零的时候。但过去改变游戏规则的技术尚未突破百分之三的门槛的事实给了我们一个基线。只有强有力的证据才能让我们期待一些截然不同的东西。

然而,许多人乐观地认为人工智能可以胜任这项工作。他们说,人工智能与之前的技术不同,因为它通常能够执行比以前技术更广泛的任务,包括创新过程本身。一些人认为它可能导致“一切事物的摩尔定律”,甚至是与疫情和核战争一样的风险。Sam Altman 说,OpenAI 将通过首先发明通用人工智能,然后询问它如何赚钱来实现盈利,这让投资者感到震惊。四年前,Demis Hassabis 在英国皇家科学院描述了 DeepMind 的使命,分两步进行:“1. 解决智能问题。2. 用它来解决其他一切。”

这种操作顺序具有强大的吸引力。

人工智能是否应该与历史上其他伟大的发明区分开来?它是否会像伟大的学者约翰 - 冯 - 诺伊曼和 I.J. 古德推测的那样,有一天会自我完善,引发智力爆炸,并导致经济增长的奇点?

本文和经济增长文献都没有排除这种可能性。相反,我们的目的只是为了降低您的期望。我们认为人工智能可以像互联网那样具有“变革性”,提高生产力并改变习惯。但是,在实现一些人所预测的加速增长的道路上有许多令人生畏的障碍。

在这篇文章中,我们汇集了我们遇到的最好的论据,说明为什么变革性人工智能难以实现。为了避免拉长文章,我们不会深入重申他们的论点。我们不是第一个提出这些观点的人。我们的贡献是把别人首先提出的一套经过充分研究的、多学科的观点整理成一个综合案例。以下是我们论点的一个简要概述:

- 人工智能的变革潜力受制于其最难解决的问题

- 尽管在一些人工智能子领域取得了快速进展,但主要的技术障碍仍然存在

- 即使人工智能的技术进步继续下去,社会和经济障碍可能会限制其影响

1. 人工智能的变革潜力受制于其最难解决的问题

变革性人工智能的愿景始于一个在所有具有经济价值的任务上与人类一样好或更好的系统。哈佛大学卡尔人权政策中心的一篇评论指出,许多顶级人工智能实验室都提出了这个明确目标。然而,衡量人工智能在一组预定任务上的表现是有风险的——如果现实世界的影响需要执行我们甚至不知道的任务怎么办?

因此,我们以其观察到的经济影响来定义变革性人工智能。生产力的增长几乎明确地体现了新技术何时有效地执行有用的工作。有一天,强大的人工智能可以执行所有富有成效的认知和体力劳动。如果创新过程本身能够实现自动化,一些经济增长模型预测,人均 GDP 增长不仅会突破每年 3%,还会加速。

这样的世界是很难实现的。正如经济学家 William Baumol 在 20 世纪 60 年代首次指出的那样,不平衡的生产力增长可能会受到最薄弱部门的制约。为了说明这一点,请考虑一个包含两个领域的简单经济:撰写思想文章和建造建筑物。想象一下,人工智能加快了写作,但没有加快建筑。生产力提高了,经济就增长了。然而,一篇思想文章并不能很好地替代一栋新建筑。因此,如果经济仍然需要人工智能不能改善的东西,如建筑,这些领域就会变得相对更有价值,并吃掉写作的收益。写作速度的 100 倍提升可能只会导致经济规模的 2 倍提升 [2]。

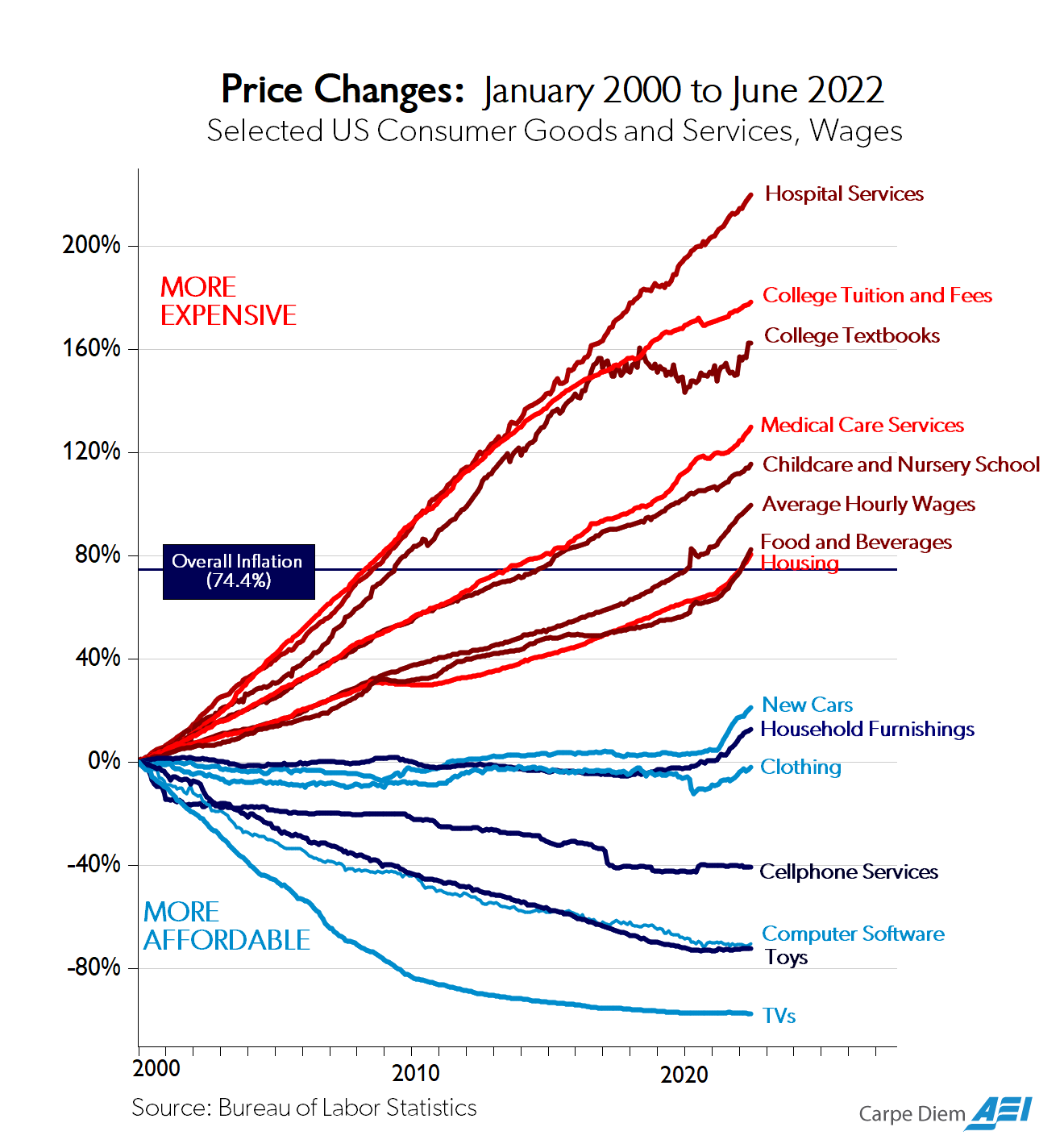

这个例子与过去几十年来生产力增长的广泛模式并没有什么不同。Eric Helland 和亚历克斯 - 塔巴罗克 Alex Tabarrok 在他们的Why Are the Prices So Damn High? 一书中引用了 Baumol 的观点,解释技术如何提高制造业和农业等部门的生产率,降低电视和食品等产出的相对价格,并提高平均工资。然而,电视和食品并不能很好地替代医疗保健和教育等劳动密集型服务。这些服务仍然很重要,就像建造建筑物一样,但事实证明很难提高其效率。因此,它们的相对价格已经增长,占据了我们收入的更大份额,并拖累了经济增长。Acemoglu、Autor 和 Patterson 使用美国历史经济数据证实,各领域的不均衡创新确实减缓了总的生产率增长。

鲍莫尔效应;美国企业研究所 (2022)

Aghion、Jones 和 Jones 解释说,创意本身有一些容易受到瓶颈影响的步骤。[4] 大多数任务的自动化与所有任务的自动化对增长的影响截然不同:

…… 经济增长可能不会受制于我们做得好的地方,而会受制于那些必不可少但却难以改进的地方。当应用于人工智能自动生产创意的模型时,这些考虑同样可以阻止爆炸性增长。

考虑一个两步的创新过程,包括总结 arXiv 上的论文和将液体移入试管。每一步都取决于另一步。即使人工智能实现了论文总结的自动化,人类仍然需要自己实验来写下一篇论文。(在现实世界中,我们还需要等待 IRB 批准我们的拨款)。在“如果我们能够实现发明自动化会怎样”一文中,Matt Clancy 提供了最后一剂直观的信息:

发明已开始类似于一个课堂项目,每个学生负责项目的不同部分,在每个人都完成之前,老师不会让任何人离开……如果我们不能把所有的事情都自动化,那么结果就会很不同。我们不会仅仅以较慢的速度得到加速 – 我们根本就没有加速。

我们的观点是,瓶颈的概念 – 从 60 年代的鲍莫尔到今天的 Matt Clancy– 值得更多的报道。[5] 这清楚地表明了为什么人工智能进步的障碍在一起时比单独时更严重。人工智能必须改变所有重要的经济部门和创新过程的步骤,而不仅仅是其中的一部分。否则,我们应该将人工智能视为类似于过去的发明的可能性就会增加。

也许论述中缺乏对生产和创新中难以改进的步骤的具体说明。但幸运的是,这方面有许多例子。

2. 尽管在一些人工智能子领域取得了快速进展,但主要的技术障碍仍然存在

精细运动控制方面的进展大大落后于神经语言模型的进展。当“在几个隔间之外,生成模型的进展感觉在质量上更令人印象深刻”时,机器人研讨会正在思考应对方法。Moravec 的悖论和 Steven Pinker 在 1994 年的观察仍然适用:“三十五年来人工智能研究的主要教训是,困难的问题是容易的,而容易的问题是困难的”。最难的“容易”问题,如系鞋带,仍然存在。机器人技术的突破会紧随生成建模的突破吗?OpenAI解散其机器人团队并不是一个强烈的信号。

在我们看来,如果在操纵物理世界方面没有取得进展,那么经济增长就不可能大幅加速。目前的许多经济瓶颈,从住房和医疗保健到制造和运输,都有相当大的物理世界成分。

与变革性人工智能相关的开放性研究问题清单仍在拉长。 学习因果模型就是其中之一。Ortega 等人展示了一个简单的案例,其中采取行动的序列模型会在没有获得因果模型的情况下出现错觉。Murray Shanahan 认为认知和拥有身体是不可分割的:认知的存在是为了身体的生存和发展,在身体的感觉运动循环中不断调整,并且认知本身建立在身体的物理承受力上。看着球场上的勒布朗 - 詹姆斯,我们倾向于同意这一点。François Chollet 认为效率是核心,因为“无限的先验或经验可以产生几乎没有泛化能力的系统”。此外,Cremer 和 Whittlestone 列出了更多技术专家没有达成一致的问题。

更多的资源并不能保证会有所帮助。Ari Allyn-Feuer 和 Ted Sanders 在“到 2043 年变革性 AGI 的可能性 < 1%”中提出,行走和蠕动(对蠕虫的神经学模拟)是简单但仍然难以解决的指标任务:“虽然蠕虫不是一个大市场……(但)我们已经完全失败了,尽管我们付出了巨大的努力,也没能制造出人工智能步行者、人工智能司机或人工智能放射科医生。这必须被视为一个看跌的信号”。

我们可能不需要解决这些开放性问题中的一些甚至全部。而且我们肯定可以取得更多的突破(我们中的一个正在直接研究其中一些问题)。但同样,我们还不能明确地否定它们,从而增加我们的瓶颈。在人工智能获得这些缺失的能力之前,其中一些甚至连儿童都具备,最好将它们视为模仿和传播文化的工具,而不是像 Yiu、Kosoy 和 Gopnik 所提出的那样,将其视为一般智能。

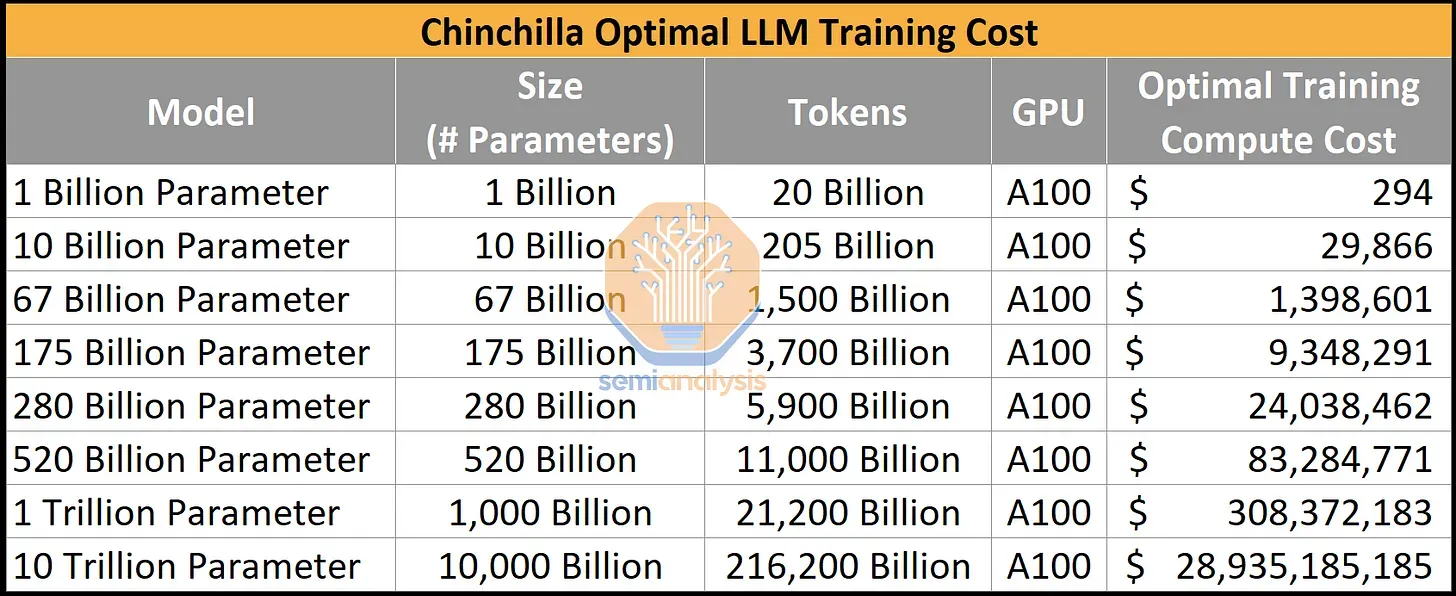

目前的方法可能还不够。 它们的极限可能很快就会出现在我们面前。将计算量再扩大一个数量级将需要在硬件上增加数千亿美元的支出。根据 SemiAnalysis 的说法:“这是不实际的,而且考虑到目前的错误率和量化估计,模型也很可能无法扩展到这个规模。”计算成本的持续下降可能会有所帮助。但我们可能已经用尽了硬件优化的低垂果实,现在正在进入一个减速的时代。摩尔定律以各种名义持续存在,但变革性人工智能的关键因素可能是我们是否会在摩尔定律停止之前实现这一目标。

接下来看看数据。Villalobos 等人警告说,高质量的语言数据可能在 2026 年耗尽。该团队建议将数据效率和合成数据作为出路,但到目前为止,正如 Shumailov 等人所展示的那样,这些还远远不是完整的解决方案。

在算法方面,我们对当前架构能做什么和不能做什么的理解正在提高。Delétang 和 Dziri 等人确定了 Transformer 架构的特别困难的问题。有人说,大型语言模型的所谓“涌现能力”仍然会让我们感到惊讶。但不一定。Schaeffer 等人认为,涌现的出现“是由于研究者对度量标准的选择,而不是由于模型行为随着规模的扩大而发生根本变化”。在对未来能力的不规则性提出主张时,我们必须谨慎。OpenAI 在一段时间内不会训练 GPT-5,这很说明问题。也许他们意识到,老式的人类修补比大规模的免费午餐更令人胃口大开。

人类仍然是发展中的一个限制因素。人类的反馈使人工智能的产出更有帮助。只要人工智能的发展需要人类的投入,人类就会限制生产力。目前,数以百万计的人类对数据进行注释以训练模型。他们的人性,特别是他们的专家知识和创造性的火花,变得越来越有价值。The Verge 报道:”一位工程师告诉我,买苏格拉底对话的一个样本需要花 300 美元。”

这种情况不太可能在短期内改变。Geoffrey Irving 和 Amanda Askell 主张让人类发挥更大的作用:“由于我们正在努力使自己的行为符合人们的价值观,最重要的数据将是来自人类的关于其价值观的数据。”宪政人工智能是一种最先进的对齐技术,甚至已经达到了国会山的台阶,它也根本不打算将人类从这个过程中移除:“从长远来看,我们的目标不是取消人类监督,而是使人类监督尽可能有效。”即使是更长期的可扩展的调整建议,如与人类法官一起进行人工智能辩论,也是在巩固而不是消除人类专家。技术专家和公众似乎都希望将人类留在圈内。

人类知识有很大一部分是隐性的、未记录的和分散的。正如 Friedrich Hayek 所宣称的那样,“假设所有知识都被灌输到一个人的脑中……就是假设问题消失并忽视现实世界中所有重要和有意义的事情。”Michael Polanyi 认为”我们能知道的比我们能说的多“。Carlo Ginzburg 表示赞同:”没有人能够仅仅通过应用规则就能学会如何成为鉴赏家或诊断家。对于这种知识,有一些因素在起作用,而这些因素是无法衡量的:一丝气息、一个眼神、一种直觉。“最后,Dan Wang 借用例子说道:

过程性知识是那种很难写成指令的知识。你可以给一个人一个设备齐全的厨房和一个特别详细的食谱,但除非他已经有了一些烹饪经验,否则我们不应该期望他能做出一道好菜。

Ilya Sutskever 最近建议询问人工智能”一个具有伟大洞察力、智慧和能力的人会做什么?“以超越人类的表现。隐性知识是我们认为这在许多重要场合不太可能开箱即用的原因。这就是为什么我们可能需要在现实世界中部署人工智能,让它可以边做边学的原因。然而,我们很难想象这种情况会在某些情况下发生,尤其是像经营跨国公司或教孩子游泳这样的高风险案例。

在我们作为记者和人工智能研究者的日常工作中,我们时常感到惊讶,有多少问题在互联网或书本上没有很好的答案,但一些专家有可靠的答案,但他们却懒得记录。在某些情况下,就像大厨或勒布朗・詹姆斯一样,他们甚至可能无法清晰地表达他们的工作方式。

分散的隐性知识是普遍存在的,这一观点支持了这样一个假设:纯粹的、集中的、脑力劳动的智力回报是递减的。有些问题,如逃离博弈论的泥潭或预测未来,对大脑来说可能太难了,无论是生物的还是人工的。

我们可能完全走错了方向。如果我们的一些障碍被证明是不可逾越的,那么我们可能离实现人工智能可以做人类能做的一切的关键道路还很远。Melanie Mitchell 在《为什么人工智能比我们想象的更难》中引用了 Stuart Dreyfus 的话:“这就像是宣称第一只爬上树的猴子在向登陆月球迈进“。

我们仍然很难具体说明我们正在尝试构建什么。我们对智能或人类的本质知之甚少。相关的哲学问题,如道德地位、感受性和个人身份的依据,几千年来一直困扰着人类。就在写这篇文章的前几天,神经科学家 Christof Koch 输掉了与哲学家 David Chalmers 打的四分之一世纪的赌注,即我们现在已经发现了大脑如何实现意识。

因此,现在的我们正在向黑暗中投掷骰子,把赌注押在我们最好的预感上,有些人认为这只能产生随机的鹦鹉学舌。当然,这些预感仍然值得追寻;Matt Botvinick 深入探讨了当前的进展可以告诉我们关于我们自己的哪些信息。但是考虑到理解不足,我们应该再次降低我们的期望。十年前,David Deutsch 提出了一个有先见之明的观点,强调了指定我们想要的确切功能的重要性:

“AGI”一词就是此类合理化的一个例子,因为该领域过去被称为“AI”——人工智能。但人工智能逐渐被用来描述各种不相关的计算机程序,如游戏玩家、搜索引擎和聊天机器人,直到添加了“通用”的 G,使其可以再次指代真实的事物,但现在的含义是 AGI 只是一种更聪明的聊天机器人。

要知道,这是十年前啊!

3. 即使人工智能技术继续进步,社会和经济障碍可能会限制其影响

经济转型的历史是一个偶然的过程。 许多因素必须同时出现,而不是一个因素胜过所有其他因素。单独的技术只有在制度允许其采用,激励其广泛部署,并允许围绕新技术进行广泛的社会重组的情况下才有意义。

一个例子是欧洲如何克服前现代的增长限制。技术进步只是一个因素。Kenneth Pommeranz 在他颇具影响力的同名著作中也主张运气,包括煤炭库存和便利的地理位置。Taisu Zhang 在《儒家思想的规律与经济学》中强调了社会等级制度。Jürgen Osterhammel 在《世界的转变》中把 19 世纪的增长归功于流动性、帝国体系、网络,以及更多超越单纯工业化的因素:“将 [生产组织和财富创造] 作为独立的变量和推动整个时代发展的唯一动力来源,是不适当的简化主义……现在是将工业革命去中心化的时候了。”

所有人都同意,历史并非不可避免。我们认为这也适用于人工智能。就像我们应该对历史上的伟人理论持怀疑态度一样,我们也不应该这么快就跳到人工智能增长的伟大技术理论。

而且重要的因素可能不在人工智能一边。增长的主要驱动力,包括人口和全球化,正在倒退。人工智能的进步甚至可能正在加速美国和中国的脱钩,减少人员和思想的流动。

人工智能可能无法准确实现最需要自动化的部门的自动化。我们已经“知道”如何克服许多制约增长的主要因素,并拥有这样做的技术。然而,社会和政治障碍减缓了技术的采用,有时甚至完全阻止了采用。同样的情况也可能发生在人工智能上。

Comin 和 Mestieri 观察到,新技术使用强度的跨国变化解释了 20 世纪收入变化的很大一部分原因。尽管 1954 年曾梦想核电会导致电力“便宜到无法计量”,但自 90 年代以来,核电在全球初次能源消费中的份额一直停滞不前。商业超音速飞行在美国空域被彻底禁止。此外,Callum Williams 提供了更多直观的例子:

尽管部分或全部取代伦敦地铁司机的技术已经存在了几十年,但伦敦公共运营的地铁司机的收入接近该国中位数的两倍。政府机构仍然会要求你一次又一次地填写提供个人信息的纸质表格。而在全球人工智能浪潮的中心旧金山,现实中的警察仍然被雇用在高峰时段指挥交通。

Marc Andreessen 不是技术悲观主义者,但他直言不讳地指出:“我甚至不认为需要标准的论据……人工智能对大多数经济来说已经是违规的,而且几乎对所有的经济都将是违规的。我怎么知道呢?因为技术在大多数经济中已经是违规的了,而且随着时间的推移,这一点会越来越真实。”Matt Yglesias 和 Eli Dourado 对人工智能会导致增长革命持怀疑态度,他们指出了包括住房、能源、交通和医疗等部门的监管和复杂的现实过程。这些恰好是我们目前的增长瓶颈,它们占了美国 GDP 的三分之一以上。

人工智能甚至可能会降低生产力。目前最大的用例之一是社交媒体推荐系统,这很难说是生产力上的意外收获。Callum Williams 继续说:

GPT-4 是一个面临规划申请的 NIMBY 的天赐之物。在 5 分钟内,他可以写出一份长达 1000 页的反对意见。然后,有人必须对其作出回应……律师将成倍增加。“在 20 世纪 70 年代,你可以用 15 页纸做一笔数百万美元的交易,因为重新打字是件很麻烦的事,”Brown Rudnick 律师事务所 Preston Byrne 说。“人工智能将使我们能够在第一份草案中涵盖 1000 个最有可能的边缘案例,然后各方将为此争论数周。”

仅仅是自动化还不足以实现经济的转型增长。 正如 Daron Acemoglu 和 Simon Johnson 在他们的新书《权力与进步》(Power and Progress)中指出的那样,历史上充斥着一些效果一般的技术,它们几乎没有产生变革性影响。与人类雇员相比,快餐亭很难改变游戏规则。诺贝尔奖获得者 Robert Fogel 记录到,以同样的方式,铁路对增长没太大影响,因为它们只比其替代品运河和公路好一点。大型语言模型的许多直接应用,从客户服务到撰写营销文案,都出现了类似的情况 [7]。

OpenAI 自己的经济学家估计,大约“19% 的工作岗位至少有 50% 的任务暴露于”GPT-4 以及可能基于其构建的各种应用程序。有些人认为这将改变游戏规则。但换个方向考虑,这是不是这意味着超过 80% 的工人只有不到 50% 的任务受到影响,很难接近完全自动化。他们的方法表明,可靠性至关重要的领域将在一段时间内保持不受影响。

很能说明问题的是,尽管投资服务行业已经数字化,数据无处不在,许多个人任务已经自动化,但总体就业人数却在增加。同样,尽管有人预测人工智能将取代放射科医生(Hinton:“停止培训放射科医生”),但放射科的工作岗位在 2021 年创下了历史新高,预计还会有更大的增长。Allyn-Feuer 和 Sanders 回顾了自 1960 年以来业内人士对自动驾驶的 31 项预测。27 个预测是错误的,这其中八个是由埃隆 - 马斯克解决的。在所有这些情况下,人工智能面临着将训练数据中不存在的、不总是可读的、或风险太大无法部署的“长尾”任务自动化的挑战。

此外,经济的很大一部分可能已经包括生产具有深刻社会性质的产出。即使人工智能可以使所有生产自动化,我们仍然必须决定生产什么,这是一个社会过程。正如 Hayek 曾经暗示的那样,中央计划很难,不仅因为其计算成本,而且还因为“缺乏获得信息的途径……信息不存在”。一个可能的含义是,人类必须积极参与商业、政治和社会,以决定他们希望的社会面貌。

教育可能在很大程度上是为了激励学生,教他们进行社会互动,而不仅仅是传递事实。艺术的大部分价值来自于其社会背景。医疗保健将情感支持与更具功能性的诊断和处方相结合。国际象棋的复兴很难完全归功于超人的人工智能。而商业是关于制定目标,与人类谈判,管理和激励。也许我们今天的工作已经与弄清楚提示什么问题以及如何提出问题没有什么不同。

这里还有更深层次的一点。GDP 是衡量一些人对其他人的生产成果的重视程度的一个虚构指标,其中很大一部分涉及到彼此之间的社交活动。正如我们中的一个最近所写的那样,我们可能重视人类生产的产品,正是因为它们是稀缺的。只要人工智能生产的产品不能替代社会性的产品,就会是稀缺的,这种产品将获得越来越多的“人类溢价”,并产生鲍莫尔式的效应,对增长产生影响。

鉴于这些障碍,我们应该如何看待人工智能?

人工智能的进步必将继续,而我们才刚刚开始感受到它的影响。从更可靠的算法到更好的政策,我们都希望能有进一步的突破。人工智能确实曾给我们带来过惊喜。

然而,正如本文所概述的,无数的障碍阻碍了广泛的变革性影响。这些障碍应该被综合起来看。解决一个子集可能是不够的。解决所有这些障碍是一个更难的组合问题。在此之前,我们不能指望人工智能来清除我们自己不知道如何清除的障碍。我们也不应该把未来的突破作为保证 – 我们可能明天就能实现,也可能在很长一段时间内都不会实现。

对于我们的论点,我们听到的最常见的回答是,人工智能研究本身可能很快就会自动化。然后,人工智能的进展将爆炸性增长,产生强大的智能,解决我们提出的其他障碍。

但这是一条狭窄的道路。尽管人工智能研究最近取得了显着的进步,但我们转型的许多障碍普遍存在于人工智能研究本身的自动化过程中。即使我们开发出高度智能的机器,这也不足以实现整个研发的自动化,更不用说整个经济的自动化了。为了建立一个可以解决其他所有问题的智能,我们可能需要首先解决其他所有问题。

因此,人工智能将是一个远远高于其他发明的案例并没有结束。也许我们应该把它看作是一个改变历史的“平凡的”技术,一个能够催化之前的伟大发明的增长。让我们回到 Aghion、Jones 和 Jones 那里:

…… 我们把人工智能作为自动化过程中的最新形式,这一过程已经持续了至少 200 年。从珍妮纺纱机到蒸汽机,再到电力和计算机芯片,自工业革命以来,生产方面的自动化一直是经济增长的一个关键特征。

回想一下,蒸汽机也是通用的。你可能不认为它像大型语言模型那样具有一般性。但是我们可以想象,将(当时无限的)煤块转化为能源会如何促使一个 19 世纪的实业家与历史的终结产生联系。

蒸汽机确实促进了经济增长,使世界大变。但我们想强调的是,人工智能最终会像蒸汽机一样,而不是在超越它。那么,该如何看待人工智能呢?

人工智能最突出的风险可能是那些普通的强大技术的风险。 人工智能发展成为自主的、不可控制的和不可理解的生存威胁的情况,必须清除经济转型所必须的同样困难的障碍。因此,我们认为人工智能最紧迫的危害是那些已经存在或在不久的将来可能存在的危害,如偏见和误用。

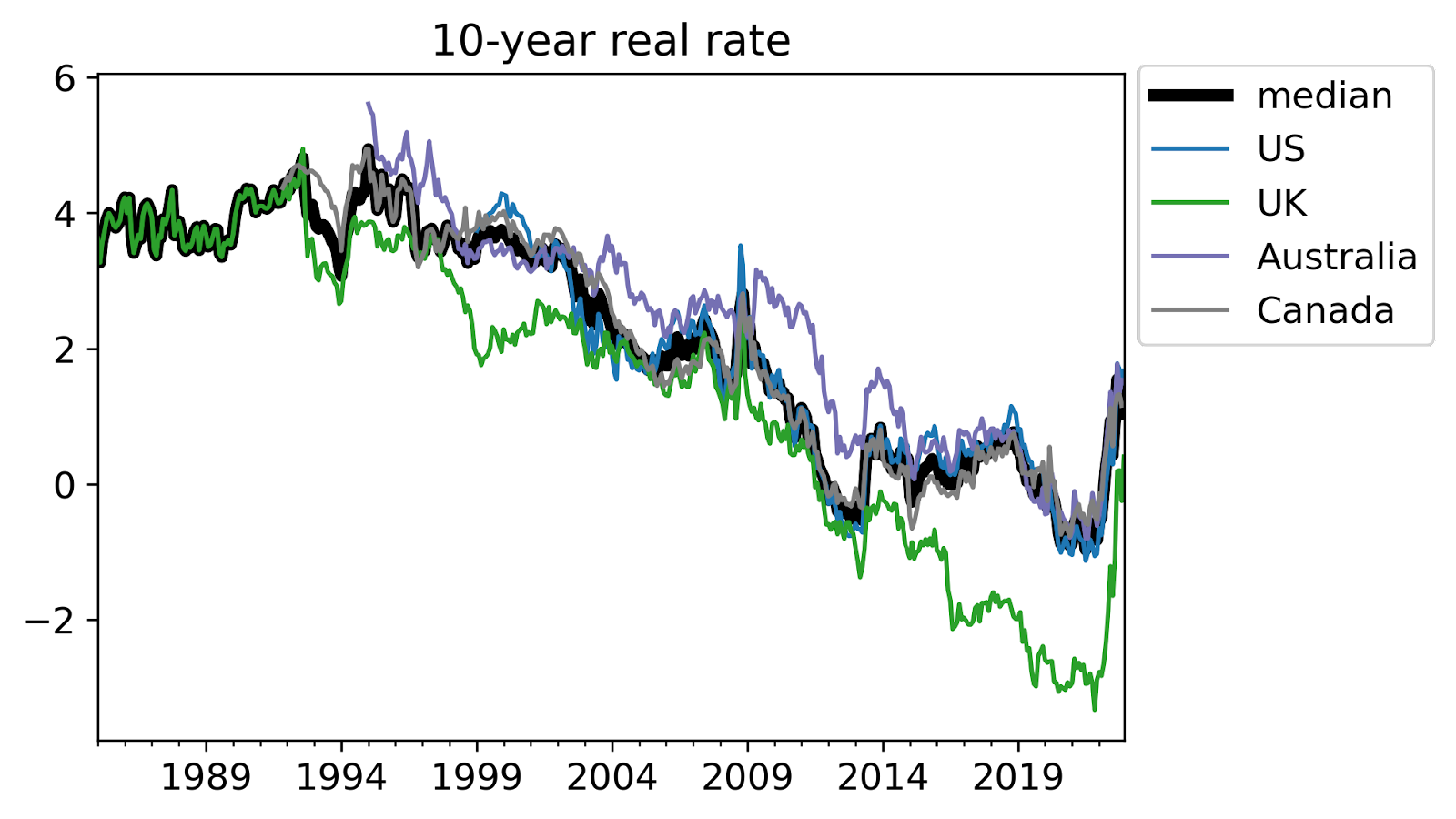

不要把未来的增长预期过度地放在一个领域的进展上。 瓶颈理论建议撒下一张大网,跟踪许多创新领域的进展,而不仅仅是人工智能的明星子领域的进展。市场也同意这一点。如果变革性的人工智能很快就会到来,实际利率会随着对未来巨大财富或风险的预期而上升。然而,Chow、Halperin 和 Mazlish 正是测试了这一理论,发现 10 年期、30 年期和 50 年期实际利率很低。

因此,投资于整个创新和社会中最困难的问题。在跳到最近人工智能领域最炫目的发展之前,请暂停一下。从目前并不流行的技术研究挑战到几代人一直存在的人际关系难题,社会的各个领域将需要一流的人类智慧来实现人工智能的承诺。

注:鉴于译文长度,文中注释请参见原文